Fin da quando è nata, l’AI è al centro delle discussioni tecniche su come usarla e come gestirla. Certamente negli ultimi tempi il clamore suscitato dai modelli generativi come ChatGPT non ha aiutato alla serenità del dibattito, ma nel mondo e anche in Italia c’è piena consapevolezza che dei miglioramenti del machine learning oggi non si può più fare a meno.

C’è però necessità di norme morali e legali. Oltre all’azione del Garante della Privacy di richiesta miglioramenti a OpenAI, editore di ChatGPT, l’Italia ha in fase di sviluppo un’azione sull’AI basata su due capisaldi: il Programma Strategico IA 2022-2024 italiano e l’AI Act, la Proposta di Regolamento europeo sull’AI.

Molto dipenderà dalla effettiva definizione che l’AI Act darà alle varie espressioni (intelligenza artificiale, machine learning) con i relativi ambiti di applicazione. Come già con il GDPR sarà comunque necessario essere conformi, mostrando quali passi concreti si siano via via adottati per rispettare la normativa.

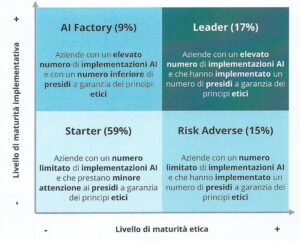

Deloitte ha sviluppato un lavoro apposito, la Trustworthy AI survey 2023 completo di un’analisi sulle imprese italiane. L’indagine è stata presentata dai partner Deloitte. Non a caso, l’introduzione è stata affidata a Tommaso Stranieri, Senior Partner Data & Privacy di Deloitte. Una figura di spicco della Security è infatti rilevante, viste le risonanze con l’approccio all’AI.

I leader preferiscono l’AI ibrida

Che rischi e che sfide si provano acquisendo soluzioni AI? “Il Regolatore si sta adoperando per governare la situazione, in modo che non vengano violati i diritti dell’uomo in generale e in particolare che non ci sia discriminazione”, spiega Daniele Langiu, Senior Partner Digital Controls CPP in Deloitte.

Guardando il report si nota che nell’assetto organizzativo delle aziende che accolgono l’AI stanno emergendo tre modelli: centralizzato, decentralizzato ed ibrido. Quest’ultimo viene detto anche Hub and Spoke, con una struttura di riferimento (hub) e svariate unità distribuite (spokes) che fungono da piccoli centri di competenza delocalizzati. Il modello preferito dalle aziende leader è ibrido.

L’EU propone anche delle linee-guida per l’etica perché non sia l’AI a decidere, bensì l’uomo, introducendo un concetto di antropocentrismo.

L’AI Ethics by design è possibile

“Il settore finanziario è partito molto prima degli altri e il 60% delle aziende ha una strategia”, ha detto Stefano Turchetta, Senior Manager Digital Controls FS.

Partendo da una sinergia dati/AI, sono tre le cose più richieste: pervasività dell’AI in settori e processi, AIEthics by design e un framework per l’AI Governance. L’intero corpus, poi, dovrebbe essere in qualche modo reso comprensibile a qualsiasi dirigente C-Level.

Dal punto di vista operativo, invece, i punti da considerare sono cinque: skill, rilevanza degli use case, integrazione, qualità/disponibilità dei dati e sviluppo di soluzioni. In particolare destano interesse le ultime tre voci, dove le soluzioni di Deloitte sono partire da una vera e propria data strategy, fare attenzione ai concetti di MLOPS ed AIEthics by design (mutuati da altre aree del coding) e ancora il framework per la governance.

Assessment e audit al centro dell’attenzione

“AI Ethics è molto più importante della privacy stessa, anche economicamente per rischi diretti o possibili sanzioni“, ha esordito Bianca de Toffè Erb, Senior Manager Data & Privacy, nella sua presentazione.

Per affrontare questi aspetti la base di partenza resta il consolidato approccio del risk management.

Partendo dalla bozza dell’AI Act europeo, le grandi aziende hanno già iniziato un assessment del loro parco software, per sapere subito cosa rientra nella nuova norma e cosa richiederà ulteriori sforzi. Questo tipo di attenzione è essenziale anche per l’acquisizione di nuovi software.

Le aziende chiedono prevalentemente audit e due diligence, certificazioni (anche ISO) da terze parti e la formazione dei C-level.

“L’AI dev’essere simbiontica all’azienda, ovvero integrarsi ad essa”, ha evidenziato Marco Rotoloni di ABI Lab. Scendendo nel caso particolare delle banche, le richieste sono collegate a sicurezza, interazione sui canali assistiti e supporto al business. Ma è allo stesso livello la richiesta collegata al grande osservato speciale del momento, il credito.

Durante la tavola rotonda finale Alberto Tripi, vicepresidente di Unindustria Lazio con delega alla Trasformazione Digitale (ma anche presidente di AlmavivA), ha posto la domanda che dovrebbe porsi qualsiasi azienda: “Posso dimostrare di controllare il processo? Se posso farlo quel che faccio va bene, altrimenti no”. Ha inoltre suggerito una mossa semplice e utile: l’instaurazione di una agenzia per l’intelligenza artificiale, sul modello di quello che già avviene con l’Agenzia per il farmaco.