Non c’è economia digitale senza infrastruttura fisica. E al centro di questa infrastruttura ci sono i data center, snodi vitali e spesso invisibili che alimentano ogni servizio, processo e interazione della nostra epoca. Mentre l’attenzione si concentra sui software, sui modelli di AI e sul cloud, ciò che li rende possibili è un ecosistema fisico fatto di megawatt, chilometri di fibra e una sofisticata ingegneria di continuità. I data center non sono più semplici spazi tecnologici: sono ambienti ad alta specializzazione che devono affrontare sfide crescenti in termini di sostenibilità, densità di potenza, sicurezza, localizzazione strategica e compliance normativa.

Comprendere le scelte architetturali, le criticità operative, i vincoli regolatori e le traiettorie evolutive di queste infrastrutture consente di leggere con maggiore chiarezza il trend in atto anche nel nostro Paese e il ruolo centrale che i data center svolgeranno sempre più nel sostenere la trasformazione digitale a ogni livello.

Nuove strategie di localizzazione

Nel panorama attuale dell’infrastruttura digitale, la localizzazione dei data center rappresenta una delle decisioni più strategiche e complesse. Non si tratta semplicemente di individuare spazi fisici, ma di orchestrare un equilibrio tra fattori energetici, connettività, rischi ambientali, costi operativi e normative locali.

A livello globale, attualmente, esiste una forte disparità nella distribuzione geografica dei data center. Secondo dati riportati sul sito statista.com, a marzo 2025 gli USA occupavano la prima posizione per numero di data center installati con 5.426: un numero superiore di oltre 10 volte a quello del Paese al secondo posto, la Germania con 529. L’Italia si colloca all’ottavo posto mondiale per numero di data center con 168.

In Italia, così come nel resto d’Europa, la ricerca di siti idonei sta spingendo sempre più investimenti verso aree a minore densità urbana ma in crescita, spesso classificate come Tier2 Cities, che offrono vantaggi in termini di disponibilità di suolo, minor concorrenza infrastrutturale e possibilità di accesso a incentivi fiscali specifici.

Città come Torino, Bologna, Lione, Malaga, Linz stanno emergendo come alternative credibili ai grandi hub tradizionali, attirando investimenti per nuovi poli data center grazie a una combinazione di manodopera qualificata, politiche favorevoli all’innovazione e buone performance logistiche. In Italia, alcune Regioni stanno iniziando a strutturare piani di sviluppo territoriale proprio per attrarre operatori e hyperscaler, con l’obiettivo di posizionarsi lungo le nuove direttrici della geografia digitale europea.

Uno degli elementi più critici da affrontare resta però la disponibilità e la qualità dell’approvvigionamento energetico necessario. I data center richiedono, infatti, un’alimentazione continua, stabile e possibilmente proveniente da fonti rinnovabili. La prossimità a impianti di produzione energetica, la presenza di reti elettriche resilienti e la possibilità di costruire “microgrid” dedicate rappresentano, pertanto, parametri chiave per la scelta della location. In parallelo, la connettività ad alta capacità resta un imperativo: la vicinanza a dorsali in fibra ottica, a punti di interscambio Internet (IXP) e a hub di rete internazionali può determinare la competitività di un sito rispetto a un altro.

Va, inoltre, considerato l’impatto delle normative, che possono variare significativamente da un Paese a un altro. Alcune aree offrono semplificazioni burocratiche, altre impongono vincoli ambientali stringenti o limitazioni sull’uso del suolo.

Infine, la crescente attenzione verso la sostenibilità sta spingendo i provider a preferire aree in cui sia più facile implementare pratiche di economia circolare, recupero termico e raffreddamento naturale.

Il data center sostenibile ed efficiente

L’efficienza energetica è diventata un criterio imprescindibile per lo sviluppo e la gestione dei data center, tanto da essere oggi uno dei principali indicatori di performance del settore.

Il PUE (Power Usage Effectiveness), che misura il rapporto tra l’energia totale consumata dalla struttura e quella effettivamente utilizzata per l’alimentazione dei server, è ormai uno standard di riferimento. Mentre i data center più avanzati riescono a mantenere valori inferiori a 1.2, la media globale resta ancora più alta, soprattutto nei mercati emergenti.

A incidere sull’efficienza complessiva sono anche le tecnologie di raffreddamento. Si stanno diffondendo sistemi a liquido, evaporativi e adiabatici, capaci di ridurre drasticamente l’impatto energetico rispetto al tradizionale raffreddamento ad aria. In alcuni casi, viene adottato un approccio ibrido che consente di adattare dinamicamente le strategie di cooling in funzione delle condizioni ambientali e dei carichi di lavoro.

Le tecnologie di raffreddamento a liquido di ultima generazione puntano a far circolare il fluido refrigerante direttamente all’interno dei chip, in contatto con le superfici più calde mentre, contestualmente, si sperimentano soluzioni per aumentare la temperatura di ingresso del liquido di raffreddamento (tipicamente acqua o una miscela di acqua e glicole) al fine di ridurre il differenziale tra sorgente calda e sistema di dissipazione, ottimizzando così il bilancio energetico dell’intero impianto.

Cresce anche l’utilizzo di nuovi gas a basso impatto ambientale in sostituzione dei refrigeranti tradizionali che hanno un impatto ambientale significativo in termini di GWP (Global warming potential).

Questi gas sono tipicamente utilizzati come fluidi refrigeranti nei circuiti di condizionamento dell’aria, all’interno di compressori e pompe di calore che vengono impiegati soprattutto nei data center di piccole e medie dimensioni o come sistemi di backup.

Una tendenza analoga si osserva anche nelle cabine elettriche di media tensione che alimentano i data center, dove si sta progressivamente sostituendo il gas SF6 tradizionalmente usato per l’isolamento degli interruttori con alternative più sostenibili a beneficio sia dell’ambiente sia della sicurezza operativa.

Un ulteriore fronte di innovazione è rappresentato dal recupero del calore prodotto dai server: numerosi operatori stanno collaborando con le utility locali per immettere il calore in eccesso nelle reti di teleriscaldamento urbano, trasformando un costo in una risorsa per la comunità. Parallelamente, cresce il ricorso a fonti rinnovabili, sia tramite contratti di acquisto diretto (PPA – Power Purchase Agreement), sia attraverso la produzione on-site con impianti solari o geotermici.

A livello normativo, l’Unione Europea ha inserito i data center all’interno delle politiche di transizione verde, con l’obiettivo dichiarato di renderli “carbon neutral” entro il 2030. In quest’ottica, iniziative come il Climate Neutral Data Centre Pact fissano parametri sempre più stringenti in termini di efficienza energetica, uso delle risorse idriche e impiego di energia verde. Questo impone ai fornitori di servizi e agli hyperscaler un’accelerazione delle strategie ESG, non solo per rispettare gli obiettivi climatici, ma anche per preservare la propria competitività nel lungo periodo.

Edge data center e prossimità digitale in risposta ai nuovi modelli di computing

Il modello edge nasce dalla necessità di elaborare i dati sempre più vicino alla loro fonte, riducendo latenza e congestione di rete. Con la diffusione di dispositivi IoT, veicoli autonomi, fabbriche intelligenti e applicazioni di realtà aumentata, si è reso evidente che il paradigma centralizzato non è più sufficiente. Gli edge data center, strutture compatte e modulari dislocate in prossimità delle fonti di generazione del dato, rappresentano oggi un’infrastruttura critica per garantire tempi di risposta rapidi, resilienza locale e continuità operativa.

Questa decentralizzazione comporta sfide tecniche e operative significative: la gestione distribuita richiede automazione spinta, monitoraggio remoto, sicurezza integrata e capacità di provisioning rapido. Gli edge data center devono integrarsi in modo sinergico con i core data center centrali, adottando logiche ibride che combinano elaborazione locale e sincronizzazione in cloud.

Sempre più spesso, si punta su soluzioni preassemblate e trasportabili che vengono inserite all’interno di container e sono in grado di essere installate in tempi ridotti e di operare in ambienti difficili. In Italia, il modello edge è particolarmente rilevante per coprire territori con minore densità infrastrutturale o per supportare progetti verticali in ambito industriale, sanitario o logistico.

Le sfide dell’alimentazione e della densificazione

Nel passaggio verso una nuova generazione di data center, la gestione dell’alimentazione elettrica non è più un aspetto “invisibile” dell’infrastruttura, ma un vero e proprio punto di rottura tecnologica e strategica. Garantire l’alimentazione e il raffreddamento continuo di ambienti a elevatissima densità computazionale rappresenta una sfida tecnica e ingegneristica che incide direttamente sull’affidabilità, sulla scalabilità e sulla sostenibilità dei servizi digitali del futuro.

La densificazione dei carichi all’interno dei rack, spinta dalla necessità di elaborazioni ad altissima intensità, impone un ripensamento radicale delle architetture di distribuzione e gestione dell’energia nei data center. L’AI, corresponsabile principale di questa trend, è caratterizzata peraltro da un elevato livello di variabilità del carico che ne rende più complessa la gestione, mettendo sotto pressione sia gli impianti UPS sia la capacità di reazione delle reti locali.

Un altro aspetto critico è il crescente fabbisogno termico generato da queste nuove configurazioni: l’elevato calore prodotto dai componenti di calcolo, in particolare dalle GPU, impone soluzioni di raffreddamento sempre più sofisticate. Il raffreddamento a liquido, con l’adozione di unità dedicate CDU (Cooling Distribution Unit) si afferma come elemento imprescindibile ma, a sua volta, introduce una nuova dipendenza energetica perché la continuità operativa dei sistemi di raffreddamento diventa essenziale quanto quella delle macchine di calcolo stesse.

Anche le batterie utilizzate nei data center stanno evolvendo sia dal punto di vista tecnologico con la transizione dalle soluzioni basate sul piombo in favore di quelle al litio o agli ioni di sodio, sia da quello della versatilità di utilizzo che trova spazio anche fuori dalle applicazioni di puro backup per abilitare strategie di “demand response”.

Il data center del 2030

Il data center del 2030 sarà radicalmente diverso da quello che conosciamo oggi. Spinto da pressioni ambientali, esigenze di potenza e nuove logiche di servizio evolverà in strutture sempre più modulari, dense e intelligenti sotto la spinta di innovazioni sempre più spinte nell’ambito dell’elaborazione e storage dei dati. Le architetture saranno pensate per essere scalabili e adattive, in grado di accogliere carichi sempre più volatili e diversificati. Saranno inoltre sempre più integrate con reti energetiche smart, progettate per interagire con fonti rinnovabili e sistemi di accumulo. In questo scenario, il data center diventerà non solo il cuore dell’economia digitale, ma anche un nodo energetico e ambientale di rilevanza strategica. Comprenderne l’evoluzione oggi significa posizionarsi con consapevolezza e visione all’interno delle infrastrutture digitali del domani.

Sovranità digitale e geopolitica dell’infrastruttura

I data center sono diventati infrastrutture strategiche al pari delle reti energetiche o delle vie di trasporto. Il loro posizionamento, controllo e proprietà incidono direttamente sulla sovranità digitale delle nazioni e sulla capacità di autodeterminazione dei sistemi economici. Le normative europee come GDPR, NIS2 e DORA mirano a rafforzare il presidio dei dati critici e a imporre requisiti minimi di sicurezza e trasparenza, anche per gli operatori internazionali. Sullo sfondo si collocano dinamiche geopolitiche sempre più tese: da un lato gli Stati Uniti, che concentrano i principali hyperscaler; dall’altro la Cina, che avanza con modelli di cloud sovrano. In mezzo, l’Europa cerca un proprio equilibrio tra apertura al mercato e tutela della propria autonomia digitale.

Data center software-defined e il ruolo dell’AI

L’automazione nei data center non è più un’opzione, ma una condizione necessaria per garantire efficienza, resilienza e scalabilità. Con l’aumento della complessità operativa e la crescente dinamicità dei carichi, si afferma il modello software-defined, in cui le risorse IT fisiche (server, rete, storage) vengono astratte e orchestrate da piattaforme intelligenti. In questo contesto, l’intelligenza artificiale gioca un ruolo sempre più centrale e rende il data center non è più un’infrastruttura statica, ma un sistema adattivo, capace di apprendere e reagire in tempo reale alle condizioni interne ed esterne. Consente, per esempio, di anticipare anomalie nei sistemi di raffreddamento, ottimizzare la distribuzione energetica in funzione dei carichi fluttuanti, regolare la velocità delle ventole in base ai profili termici e ridurre i tempi di intervento tecnico grazie a modelli di manutenzione predittiva. Nei data center più avanzati, l’AI viene impiegata anche per gestire l’allocazione dei carichi di lavoro tra cluster distribuiti in base a criteri di efficienza energetica, disponibilità di risorse e costi operativi.

La corsa energetica dei data center e la spinta dell’AI

Negli ultimi anni il consumo elettrico globale dei data center è entrato in una fase di accelerazione senza precedenti, spinto dalla digitalizzazione diffusa e, sempre più, dalla diffusione delle tecnologie di intelligenza artificiale. Secondo il report Energy and AI pubblicato dalla International Energy Agency (IEA) ad aprile 2025, il consumo di elettricità dei data center ha raggiunto nel 2024 circa 415 TWh, pari a circa l’1,5% del consumo elettrico mondiale. Un valore che ha già superato quello dell’intero settore elettrico di nazioni industrializzate come la Francia.

Guardando al passato, tra il 2017 e il 2023, la crescita media annua della domanda elettrica dei data center è stata di circa +12%, ben superiore al ritmo complessivo della domanda globale di elettricità. Questo incremento si è intensificato con l’ascesa dell’AI generativa e l’espansione di servizi digitali ad alta intensità computazionale. L’IEA stima che nel 2024 l’intelligenza artificiale sia stata responsabile del 15% del consumo totale dei data center, ovvero oltre 60 TWh all’anno, un valore paragonabile al consumo elettrico dell’intero Portogallo.

Ma è nel prossimo decennio che l’impatto dell’AI si farà davvero sentire. Nello scenario base delineato dall’Agenzia, il consumo totale dei data center è destinato a più che raddoppiare entro il 2030, raggiungendo circa 945 TWh: una quantità superiore al consumo totale del Giappone.

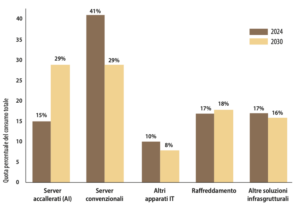

In questo aumento, l’intelligenza artificiale giocherà un ruolo determinante: il 70% della crescita prevista tra il 2025 e il 2030 sarà attribuibile proprio ai carichi AI, in particolare ai cosiddetti server accelerati, sistemi progettati specificamente per gestire modelli complessi e training su larga scala. Il ritmo di crescita di questi server AI sarà vertiginoso secondo l’IEA: +30% annuo, contro il +9% dei server tradizionali.

Va, tuttavia, osservato che l’uso dei server accelerati come riferimento per stimare il consumo dell’AI è una misura utile ma imperfetta. Sebbene la maggior parte dei carichi AI, in particolare quelli di training, venga elaborata su hardware specializzato, alcune operazioni di inferenza AI (il processo con cui un modello di AI genera l’output applicando la conoscenza conseguita sui dati di addestramento a dati sconosciuti) si svolgono anche su server convenzionali così come non tutti i carichi dei server accelerati sono legati all’AI. Inoltre, è possibile che in futuro alcune attività di inferenza potrebbero spostarsi dai data center ai dispositivi degli utenti finali, come smartphone e laptop, rendendo ancora più incerta la quantificazione precisa del fabbisogno energetico generato dall’AI.

In ogni caso, questa dinamica rappresenta una sfida strategica di prima grandezza per il settore energetico globale. L’alimentazione di data center ad alta presenza di AI richiederà una combinazione flessibile e resiliente di fonti, in cui le rinnovabili avranno un ruolo primario, ma sarà inevitabile anche il ricorso ad altre soluzioni come il gas naturale e c’è già chi parla di nucleare modulare con potenza compresa tra 10 e 300 MW o micro reattori nucleari con potenze generalmente inferiori ai 10 MW.

L’AI, da parte sua, potrà contribuire a ottimizzare l’intera catena dell’energia, ma il bilancio energetico netto di questa trasformazione resta ancora incerto, soprattutto alla luce delle infrastrutture richieste, delle interconnessioni con le reti e dei rischi di congestione.